「AIにできないこと」を各界のリーダー10人が解説!私たちが知っておくべき限界とは

「AIが全てを変える」「AIで人間の仕事がなくなる」といった情報があふれる昨今、本当にAIは万能なのでしょうか?

実は、世界の第一線で活躍する各界のリーダーたちが、AIの重要な限界について警鐘を鳴らしています。これらの限界を理解することで、AIとの正しい付き合い方が見えてきます。

今回は、日本の有識者の見解から始まり、海外の著名人たちが指摘するAIの10の限界と、私たちがどう対応すべきかをまとめました。

この記事で分かる「AIができないこと」

世界の各界リーダーたちが指摘するAIの苦手分野を整理すると、以下の10の分野に分けられます。

🎭 作ること・表現することの苦手分野

- 過程の価値: 何かを作り上げていく過程を共有する楽しさ

- 物語を作る力: 自分の経験や感情を込めたストーリー作り

- 本当のオリジナリティ: 「えっ!」と驚かせるような新しいアイデア

🧠 考えること・判断することの苦手分野

- 難しい判断: いろんな人の立場を考えて決める複雑な判断

- 常識破りの発想: 今までの常識をひっくり返すような新しい考え方

- 深く集中して考える力: 人間ならではの集中力で生まれる質の高いアイデア

⚠️ 安全面での心配事

- コントロールできなくなるリスク: AIが勝手に賢くなりすぎて、人間が制御できなくなる危険性

🤖 AI技術の根本的な限界

- 真の共感ができない: 表面的な優しさは真似できても、本当の理解や共感はできない

- ジグザグな知能: 難しい問題は解けるのに、簡単なことで致命的なミスをする

- 空間を理解できない: 3D世界を本当に理解することの難しさ

これらの苦手分野を知ることで、AIに任せても大丈夫なこととやっぱり人間がやるべきことの線引きがはっきりしてきます。

1. 体験や思い出の価値は作れない【西野亮廣・キングコング】

絵本作家でエンターテイメントプロデューサーの西野亮廣さんは、AIでは作れない5つの「アンカー(錨のような、しっかりとした価値)」について話しています。

AIでは作れない5つの価値

- 場所 - その場所だからこそ味わえる特別感

- 時間 - その瞬間だけの貴重な体験

- 過程 - みんなで何かを作り上げていく楽しさ

- つながり - 人と人との関係やコミュニティ

- 思い出 - 心に残る大切な記憶

「何かを作り上げていく過程を見せる物語は、人間だけができることだ」

西野さんは、AIで作ったアイドルバンド「バンドザウルス」のプロジェクトで実際に試してみました。「AIで画像を作って、それを現実のマスクにして、また写真に撮る」という面倒くさい作業こそが価値なんだということを証明しています。

キングコング西野「AIが絶対に生成できないモノ」 ※切り抜き動画

私たちへの教訓

体験することの大切さ

- 何かを作る過程をみんなで共有する価値

- お客さんやファンとの関係作り

- その時その場所でしか味わえない特別な体験

できること

- 作業の過程を隠さずに見せる

- お客さんも一緒に参加できる企画を作る

- 地域の特色や「今だけ」の価値を活かす

2. 真の共感と深いつながりはできない【サム・アルトマン(OpenAI CEO)】

ChatGPTを作ったOpenAIのCEO、サム・アルトマンは、AIをセラピー(心の治療)に使うことのリスクについて重要な指摘をしています。

「あるスペースはアルゴリズムにとってあまりに神聖すぎる」(2025年7月31日、Luméa記事)

アルトマンさんは、AIは言葉のパターンを真似して「共感的」な返事を返すことはできるけれど、本当の相互理解や、時には厳しいけれど必要なアドバイスをすることはできないと説明しています。深い人間関係や自分の心と向き合う領域をAIに任せることの危険性を「神聖すぎる」という言葉で表現しています。

参考: Luméa記事

私たちへの教訓

本当の共感の大切さ

- 表面的な優しい言葉と本当の理解は違う

- 深い人間関係には時間と経験が必要

- 心の悩みには人間同士のつながりが不可欠

できること

- 大切な相談事は信頼できる人間にする

- AIの助言は参考程度に留める

- 人と人とのつながりを大切にする時間を作る

3. 完璧そうに見えて致命的なミスをする【サンダー・ピチャイ(Google CEO)】

GoogleのCEOサンダー・ピチャイは、現在のAIの奇妙な特徴について正直に話しています。

「AJI――Artificial Jagged Intelligence(人工ジグザグ知能)という言葉を使う。AIは難問を解く一方、文字数を数え間違えたり指示を混乱させたりする」(2025年6月17日、startupHakk)

AIがデモンストレーションでは驚くような成果を見せるけれど、簡単な計算や文字を数えることで致命的な間違いを犯すことがあると指摘しています。「ジグザグ知能」という造語で、優れた部分とダメな部分が混在する現状を表現し、「簡単に会社全体に導入する前に、実際に試してみることを徹底すべき」と警告しています。

参考: startupHakk

私たちへの教訓

AIの不安定さを理解

- 難しいことができても、簡単なことで失敗する

- デモと実際の使用では結果が違うことがある

- 完璧に見えても、チェックが必要

できること

- AIの結果は必ず人間が確認する

- 重要な作業では複数の方法で検証する

- 段階的に導入して、問題がないか様子を見る

4. 3D世界を本当に理解することはできない【フェイ=フェイ・リー・Stanford HAI所長】

スタンフォード大学HAI(Human-Centered AI Institute)所長のフェイ=フェイ・リー教授は、AIの次なる大きな挑戦について話しています。

「3D世界をモデル化することは、言語処理以上に困難なのかもしれない」(2025年7月1日、AI Startup School講演)

リー教授は、2D画像を認識したり言語を処理することは上達してきたAIでも、3D環境を直感的に把握したり、物理世界でのやり取りを理解する「空間知能」は格段に難しいと指摘しています。本当に賢いAI(AGI)を作るには、いろんなセンサーの情報をまとめて、物理世界での動きを理解できる能力が必要だと述べています。

参考: YouTube講演

私たちへの教訓

物理世界の複雑さ

- 画面の中と現実世界は全く違う

- 空間を理解することの難しさ

- ロボットと人間の動きの違い

できること

- 物理的な作業では人間の判断を重視する

- 3D設計や空間デザインでは人間の感覚を活かす

- ロボット導入時は安全性を最優先にする

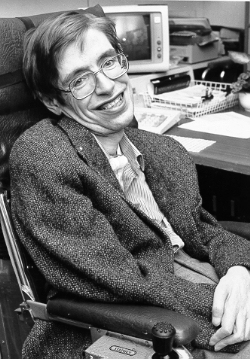

5. 人間がコントロールできなくなる危険性【スティーブン・ホーキング博士】

「車椅子の天才科学者」として知られる理論物理学者のスティーブン・ホーキング博士は、2014年に強い警告を出しています。

「私たちはAIによって、悪魔を呼び出そうとしている。でも、その悪魔をコントロールすることは不可能だ」

AIが自分でどんどん賢くなっていくと、人間では理解できないレベルまで達してしまう可能性があると心配しています。「生き物である人間はゆっくりとしか進化できないけれど、すごいスピードで進化するAIとは勝負にならず、人間が追い越されてしまうだろう」と警告しています。

私たちへの教訓

安全にAIを使うために

- システムが暴走しないような仕組み作り

- 大事な判断は必ず人間が最後に決める

- 少しずつ試しながら慎重に導入する

できること

- 小さな実験から始めて、様子を見ながら大きくしていく

- 何かあった時にすぐ止められる仕組みを作っておく

- 定期的にシステムをチェックして、おかしなところがないか確認する

6. 人類が滅びるかもしれないリスク【イーロン・マスク(テスラCEO)】

電気自動車のテスラや宇宙開発のSpaceXで有名なイーロン・マスクは、AIの危険性について一貫して警告し続けています。

「完全なAIは人類の終わりをもたらす可能性がある…確率は10〜20%だけど、無視できない数字だ」(2025年Joe Roganポッドキャスト)

「私たちはAIによって、悪魔を呼び出そうとしている。魔法陣と聖水を持った男が『悪魔をコントロールできる』と思っているような話だが、実際はうまくいかないものだ」

安全対策やルール作りをしないまま超高性能AI(AGI)を世に出してしまうと、人類は単なる「起動プログラム」のような存在になってしまうと警告しています。

参考: Business Insider

私たちへの教訓

人類の生存を考えた技術開発

- AIの進歩スピードと安全性のバランスを取る

- ルール作りと技術革新を両立させる

- 長期的な視点で人類の未来を考える

できること

- AIの安全性を何よりも優先して開発する

- 世界中で協力してルールを作る

- 技術の進歩を透明にして、みんなで話し合いながら進める

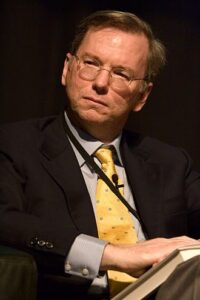

7. 全く新しい発見ができない【エリック・シュミット(元Google CEO)】

Googleの元CEOエリック・シュミットは、2017年のRSA会議で面白い話をしています。

「AIが初めて写真の中の"猫"を認識できた時、『これで新しい数学も発見できるようになるだろう』と思っていた。でも、まだそこまではいっていない」

ルールや目標がどんどん変わっていく現実の世界では、AIはまだ本当の意味での創造力を発揮できていないと指摘しています。「変化し続ける目標を解けない限り、AIは新しい学問分野を作ることはできない」と述べ、これまでの「データをたくさん集める」考え方から「変わり続ける環境にどう対応するか」という課題に研究の焦点を移す必要があると強調しています。

参考: PCMag

私たちへの教訓

常識をひっくり返すような発見をする

- 今までの枠組みを超えた新しい考え方

- 偶然の発見を活かす柔軟さ

- 変化し続ける環境に対応する力

できること

- 違う分野の人たちと交流して、新しい視点を得る

- 失敗を恐れずに試行錯誤できる環境を作る

- 失敗からも学べる文化を育てる

8. 深く集中して物語を作る力がない【リンダ・グラットン・ロンドンビジネススクール教授】

働き方研究の第一人者であるリンダ・グラットン教授は、AIと人間の思考プロセスの根本的な違いを指摘しています。

「AIは膨大なデータを高速で探すことはできるけれど、自分の記憶や経験を織り交ぜて物語を作り上げる人間の創造プロセスには関わることができない」

「深く集中すること」と「人とのつながり」の時間をきちんと設計し続けることで、私たちは価値のある仕事を続けることができると提言しています。知識労働者は「深い集中」と「つながり」の時間をデザインし続けることで価値を残すと述べています。

参考: 東洋経済オンライン

私たちへの教訓

人間ならではの思考能力

- 集中して考えることで生まれる質の高いアイデア

- 自分の経験や感情を込めた物語作り

- 人とのやり取りの中から生まれる気づき

できること

- 集中できる時間と場所をしっかり確保する

- 自分の経験を物語として伝える技術を身につける

- 人とのつながりを大切にした活動を心がける

9. 「えっ!」と驚かせることができない【トゥヒン・チャクラボルティ博士・Salesforce AI研究者】

AIで有名なSalesforceの研究者、トゥヒン・チャクラボルティ博士は、科学的な研究でAIの創造力の限界をはっきりと示しています。

「AIの言語モデル(LLM)は、確率的に『次に来る可能性が高い単語』を積み重ねているだけ。意表を突くユーモアや、完全に新しいスタイルは真似できない」

博士の研究では、プロの編集者がそろって指摘するAI特有の7つの「ありきたりさ」(決まり文句、いらない説明など)があることが分かりました。「驚き」「意外性」「皮肉」など、高度な創造性を測る指標では、どのAIモデルも差がなく、人間の編集がやっぱり必要だということが証明されています。

参考: OpenReview論文

私たちへの教訓

オリジナリティの価値

- 予想外の発想とアプローチ

- ユニークな視点や表現方法

- 意外性のある組み合わせを作る力

できること

- 常識にとらわれない考え方を練習する

- いろんな経験をして、幅広い知識を身につける

- 小さな実験をたくさん繰り返す習慣をつける

10. 難しい判断ができず、説明もできない【平井伸治・鳥取県知事】

鳥取県の平井伸治知事は、2024年5月の記者会見で、自治体でのAI活用について分かりやすい例えで重要な指摘をしています。

「生成AIに自治を任せるのは、自動販売機にコインを入れるようなもの。価値判断が欠けている」

地方自治体の仕事は「お金のこと」「福祉のこと」「災害対策」など、いろんな大事なことを天秤にかけて決める判断の連続だと説明しています。でも、どうしてその答えを出したのかが分からない生成AIでは、住民への説明責任を果たせないし、みんなで話し合って決めることもできないと述べています。

参考: 文春オンライン

私たちへの教訓

複雑な判断の必要性

- いろんな立場の人たちの利害を調整すること

- 道徳的・倫理的な判断を伴う決断

- なぜそう決めたのかを説明する責任

できること

- 大事な判断では、AIの提案は参考程度に留めておく

- 決めるプロセスをはっきりさせて、人間が最終的な責任を持つ

- なぜその判断をしたのかを説明できる体制を整える

AI活用の現状と課題

実際の導入状況

AI活用で期待以上の効果を出している会社と、期待ほどの効果が出ていない会社の違いは、AIを単なる道具として使うのではなく、AIを事業の中心に据えて本格的な変革に取り組んでいるかどうかにあることが分かっています。

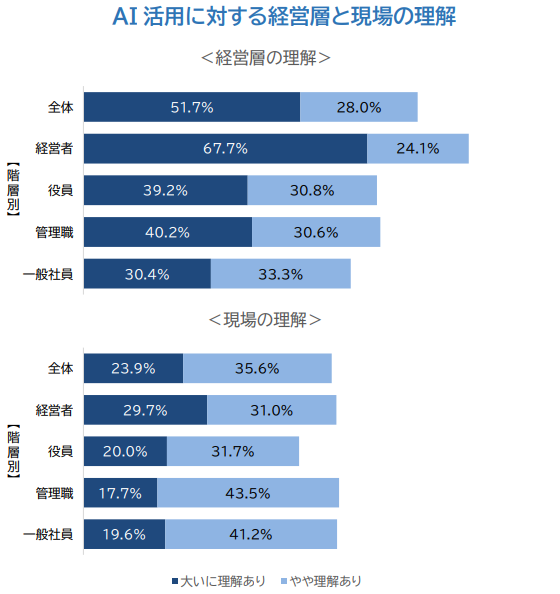

理解度のギャップが問題

- 経営者:67.7%が「AIのことを理解している」と回答

- 一般の社員:30.4%が「AIのことを理解している」と回答

この大きな理解度の差が、組織全体でのAI活用を妨げる要因となっています。

参照元:帝国データバンクが2024年6月14日〜7月5日に実施した「生成AIの活用状況調査」

AI時代に私たちが身につけたい能力

1. 批判的に考える力

- AIの答えをそのまま信じない判断力

- 情報が正しいかどうかを見極める能力

- いろんな角度から物事を検討する姿勢

2. 創造的に考える力

- 今までの枠組みを超えた発想

- 人間ならではの感性と直感

- 体験や感情に基づいた価値作り

3. 協力・共感する力

- 人と人とのつながりを大切にすること

- コミュニティを作って維持する能力

- 他の人の気持ちや状況を理解すること

まとめ:AIと一緒に生きていく未来への準備

世界の各界リーダーが指摘するAIの10の苦手分野を理解することで、以下の大切なポイントが見えてきます。

大切な気づき

- AIは強力な道具だけれど、何でもできるわけではない

- 人間にしかできない価値作りの領域がちゃんと存在する

- AIとの適切な役割分担が成功の鍵

- 継続的に学んで、変化に適応することが欠かせない

これからの行動指針

- AIの苦手分野を理解した上で活用する

- 人間特有の能力(創造性、判断力、共感力)を磨き続ける

- 技術に振り回されず、本質的な価値作りに集中する

- 長期的な視点でAIとの関係性を築いていく

AI時代において大切なのは、技術の進歩に惑わされることなく、人間としての本質的な能力を大切にしながら、AIと協力して新しい価値を作っていくことです。

各界リーダーたちの警告や提案を参考に、バランスの取れたAI活用を心がけていきましょう。